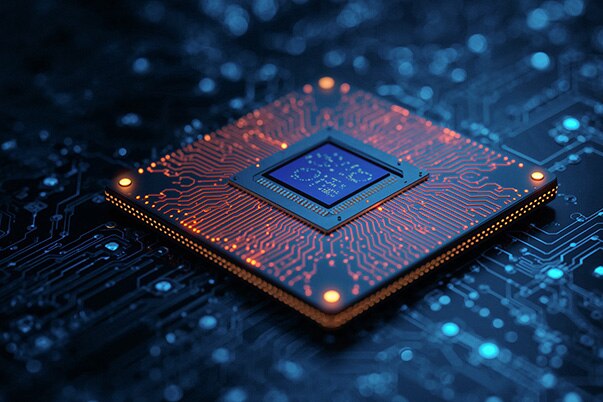

欺骗的新时代:AI 身份的威胁

身份作为企业信任的核心基石之一,将成为 2026 年的核心战场。这场危机是我们

去年识别到的趋势延续,我们预测新兴技术将催生“庞大的新型攻击面”。现在,攻击面不仅仅是网络或应用程序,而是身份本身。这一新兴现实,最直观的具象体现便是“CEO 数字替身”:一款由 AI 生成、与企业领导者惟妙惟肖的完美复刻体,能实时对企业发号施令。

这种全新的欺骗时代已成为必然,由多重因素驱动。生成式 AI 正实现“无瑕疵的实时复刻”,让深度伪造与真实难以区分。企业在管理大量机器身份时已经举步维艰,而机器身份的数量现在已经以 82:1 的惊人比例超过了人类员工,因此这种威胁被放大了。自治型智能体可按指令自主行动、无需人工干预,这带来了最后一个关键漏洞:单个伪造身份就能触发一连串自动化操作。

最终引发身份认证危机。在最高决策层面,高管们将无法区分合法指令与完美的深度伪造内容。在运营层面,当权限所对应的身份本身都能被伪造时,静态访问权限便失去了意义。

驾驭这个新时代需要“安全第一”的基础。这将身份安全从被动的保障转变为主动的信任推动者,确保企业中每个人类、机器和 AI 智能体的安全。

![The New Insider Threat: Securing the AI Agent]()

新的内部威胁:保护 AI 智能体

在过去的十年中,首席信息官们一直在进行一场艰难的人才争夺战。我们称其为“技能缺口”,但这其实是一道难以弥合的永久鸿沟。虽然从 IT 到金融,各行业都受此影响,但危机在网络安全领域最为严峻:该领域存在 480 万2人才缺口,现有团队已深陷告警疲劳的泥沼(超 70%3)。

预计到 2026 年,企业将部署一大波 AI 智能体,网络缺口的说法将从根本上改变。企业大规模部署这类智能体后,终于能为安全团队提供其迫切需要的 “力量倍增器”。对 SOC 而言,这意味着自动分流警报、终结“告警疲劳”,并在数秒内自主拦截威胁。对于 IT 和财务部门来说,这意味着以机器速度解决复杂的服务单或处理端到端的财务工作流。这些智能体将大幅缩短响应与处理时间,让人类团队从“手动操作者”转变为“新型 AI 劳动力的指挥者”。

但需要明确的是:部署自治型智能体既是战略刚需,也暗藏固有风险。

自治型智能体虽是“不知疲倦的数字员工”,但也可能成为“内部威胁”。这种智能体始终在线、不知疲倦、无需休息,可一旦配置不当,就能获取核心 API、数据与系统的特权访问权,且默认被信任。若企业在部署智能体时,未像重视落地那样重视安全,就会埋下灾难性的漏洞。

这定义了新的战场。成功的唯一路径是拥抱“可控的自治”,这引出 2026 年的核心预测,两大趋势将在此碰撞:

- AI 智能体攻击激增: 攻击者将不再以人类为主要目标。而将攻击目标转向了智能体。只需一次精心设计的提示注入,或利用“工具滥用”漏洞,就能控制企业最强大、最受信任的“员工”。突然之间,攻击者不只是在企业内部有了立足点,还是会拥有一个听其指挥的自治型内部人员:可静默执行交易、删除备份,或横向渗透以窃取整个客户数据库。

- 对 AI 安全的要求: 对此,2026 年企业将大规模采用一类全新的、不可或缺的 AI 治理工具。这个重要的“断路器”层将为所有 AI 资产提供持续的发现和态势管理,最关键的是,它将在运行时充当“AI 防火墙”。它将是唯一能够阻止机器高速攻击的设备,能够在攻击发生时识别并阻止提示注入、恶意代码、工具滥用和人工智能代理身份冒充,同时不断对代理进行重新组队,以在攻击者之前发现漏洞。

这将是 AI 成败的分水岭。

2026 年将是这一巨大分化的年份。我们会看到两类企业将浮现,一类在“可控的自治平台”上构建未来,另一类则赌上了不安全的自治模式,并为此付出代价。

![The New Opportunity: Solving the Data Trust Problem]()

新机遇:解决数据信任问题

2026 年,一种全新的攻击前沿将是“数据投毒”,即通过篡改训练核心 AI 模型所用的海量数据(这些模型运行在支撑现代 AI 数据中心的复杂云原生基础设施上),以隐蔽方式实施破坏。攻击者会在数据源处篡改训练数据,植入隐藏后门,构建不可信的“黑箱”模型。这标志着数据外泄方式的根本性变化。当攻击嵌入企业核心智能的训练数据时,传统的边界防护已毫无意义。

这种新威胁暴露了一个关键的结构性缺口:它是组织性的,而非技术性的。如今,懂数据的人(开发者与数据科学家)和负责基础设施安全的人(首席信息安全官团队)处于两个割裂的世界。这造就了致命的盲区。

安全团队关注“传统威胁”。他们认为云基础设施“安全”(大门已锁)。如果对数据和 AI 模型本身没有可见性,这正是数据安全态势管理 (DSPM) 和 AI 安全态势管理 (AI-SPM) 等工具要弥补的可见性差距。这些工具虽已面市,但随着 2026 年 AI 工作负载与数据量激增,它们将成为云环境下的硬性必选项。你无法保护自己看不到的东西。与此同时,数据团队懂数据,但未接受过识别恶意、隐蔽篡改行为的培训。

双方团队都无法掌握全局。数据投毒的得逞逻辑正是如此:它不会破门而入,只是伪装成“合法数据”悄然潜入。对领导者而言,这引发了信任危机:若流经云的数据不可信,基于这些数据构建的 AI 也不可信。

挑战不再只是保护云,而是要实时理解并保护云之上运行的所有内容 — 从第一行代码到运行中的应用。

有效的防御必须将这两个领域整合到单一平台上。这始于全面的可视性 — 借助 DSPM 与 AI-SPM,从开发者工作台到应用全生命周期,掌握数据风险、安全态势与权限。但仅靠可视性并不能起到保护作用。其次,它必须提供真正的运行时保护。这正是现代云运行时智能体与软件防火墙 (SWFW) 的核心作用:它是随应用本身分布式部署的“代码化防火墙”。二者结合,是唯一能识别并拦截恶意数据的组件,不仅能在数据进入网络时拦截,还能在数据在应用程序间移动、被 AI 模型处理时进行拦截。

2026 年,能驾驭可视性与安全性融合的组织将胜出。这样一个统一的平台是值得信赖的 AI 的基础。更重要的是,它提供了智能体 AI 所需的“燃料”,也就是单一、全面的可信源,助力其突破人类规模的分析局限。通过解决人力孤岛问题,我们为 AI 自主检测和阻止复杂威胁提供了所需数据,开创了安全云原生基础设施的未来。

新裁决:AI 风险与高管问责

2026 年,争夺 AI 驱动优势的竞赛将撞上法律现实的壁垒。“AI 出问题时谁该负责”这一问题,将从哲学辩论转变为法律先例问题,催生出“高管治理 AI 企业需承担直接个人责任”的新标准。

这一趋势源于两大推动力。第一,高管层要求 不惜一切代价推进 AI 转型。其次,要清醒地认识到采用方面的差距:Gartner® 预测,到 2026 年,40%4 的企业应用程序将采用针对特定任务的 AI 智能体,但研究表明,仅有 6% 的组织制定了先进的人工智能安全战略。5

这种仓促、不安全的部署,催生出责任领域的“新裁决”。首例“因恶意 AI 智能体行为让高管承担个人责任”的诉讼,将彻底重塑安全职能的定位。

AI 项目将不再因技术限制停滞,而是因“无法向董事会证明风险已受控”而停滞。要破除创新阻碍,首席信息官 (CIO) 必须从“技术守护者”进化为“战略赋能者”,或与“首席 AI 风险官 (CAIRO)”这类新职能协作,这些新职能的核心任务是衔接创新与治理。

这类新职能需要从根本上转变理念,将 AI 风险重构为数据问题。碎片化工具之所以失效,是因为它们会造成数据孤岛与盲区,让“可验证的治理”无法实现。唯一可行的解决方案是统一平台:它通过构建单一可信源来实现治理,从实时监控、智能体级“终止开关”,到保护模型、保障数据安全与管控智能体。安全职能也将摆脱“创新阻碍者”的标签,成为可持续长期优势的核心赋能者。

新倒计时:量子时代的必然要求

未来那场悄无声息、无形的“数据盗窃”其实已悄然完成。我们在

2025 年预警过的“先窃取,后解密”威胁,曾看似是小众风险,但 AI 已大幅加快了这一威胁的演进节奏。到 2026 年,这一现实将引发史上规模最大、最复杂的密码迁移:各国政府将强制要求关键基础设施及其供应链启动向“后量子密码学 (PQC)”的转型。

转折点将随首批政府强制令到来:这些强制令要求制定 PQC 迁移的限时计划,再加上公开的量子计算里程碑突破,这会将威胁的窗口期从 10 年缩短至 3 年。这些事件的叠加,将迫使企业直面这场转型的巨大运营复杂性:从证书管理到性能损耗,挑战无处不在。

对高管层而言,这一挑战分为三重。第一,量子就绪转型是一项庞大的运营工程,而“密码可视性的根本缺失”让其复杂度无限攀升:大多数组织无法区分哪些算法只是在系统中可用,哪些算法在实时会话中被积极使用。第二,如今被盗的所有数据都将成为未来的负债,形成“追溯性不安全”问题。第三,大多数组织缺乏精细化的安全控制能力,无法在整个基础设施中发现并拦截过时、脆弱的密码算法,这让可控的迁移几乎无法协调。

因此,目标并非单次升级。而是企业整体安全态势向“密码敏捷性”的战略演进,即在不重构企业架构的前提下,灵活适配、切换密码标准的能力。这是长期安全的全新硬性基础,转型必须从现在开始。

新连接:浏览器作为新型工作空间

浏览器正从“信息整合工具”进化为“智能体平台”,能代表用户执行复杂任务。因此,当企业争相部署这类浏览器以提升生产力时,首席信息官与首席信息安全官面临一个关键困境:如何在推动这场转型的同时,保障这一“新操作系统”的安全。尽管终端控制与安全访问框架提供了必要的防护层,但浏览器的新型智能体能力形成了独特的可视性缺口,需要专门的安全层来全面保护这扇“前门”,抵御先进的 AI 交互威胁。

这类新型浏览器衍生威胁已开始激增。我们的研究发现,

生成式 AI 流量增长超 890%,仅去年一年,相关数据安全事件就翻了一番。风险覆盖多类场景:从无意的数据泄露(如员工好心将机密知识产权粘贴到公共大语言模型中),到复杂攻击(如恶意提示诱骗 AI 客服机器人泄露其他客户的个人数据,或执行未授权操作)。

大型企业需应对这扇“AI 前门”的安全防护,而中小企业将面临生存威胁。由于缺乏专门的安全团队,又是在自带设备 (BYOD) 的环境中运行,中小企业的整个“网络”都可能是浏览器。对于这些高价值、低抵抗力的目标来说,一次数据泄露不仅是一次漏洞,还有可能导致公司的灭顶之灾。

管控这类智能体交互的迫切需求,将推动浏览器自身进化,成为新的控制架构。这一现实要求防护从“保护物理场所”向“保护无处不在的数据”果断演进。要解决这个问题,需要一个统一的云原生安全模型,在交互点(浏览器内部)实施一致的零信任安全。这样就能在流量加密并进入网络前对其进行检测,实现精细化管控:动态屏蔽提示中的敏感数据、阻止未授权截图、拦截非法文件传输。